Wirtualizacja naszego życia i gospodarki idzie w parze z rozwojem sztucznej inteligencji. Dr Aleksandra Przegalińska traktuje w swoich badaniach sztuczną inteligencję jak gałąź filozofii. Dzięki niej oswajamy zupełnie nowy świat robotów czy samouczących się systemów komputerowych.

Tekst: Agata Czarnacka

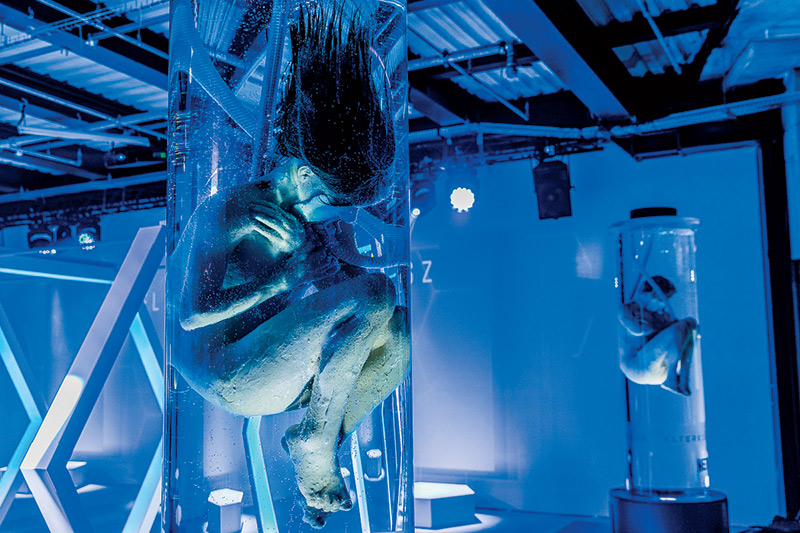

Zdjecia: Marcin Oliva Soto dla Netflix

Skąd wzięła się pani fascynacja filozofią sztucznej inteligencji?

Zaczęłam od studiowania dziennikarstwa, ale szybko zmęczyło mnie to, że uczę się warsztatu, ale nie otrzymuję pogłębionego wykształcenia akademickiego. Ponieważ najbardziej interesowały mnie zajęcia o teoretycznym charakterze, np. teoria mediów, zdecydowałam się pójść na filozofię. Tam miałam niesamowite szczęście spotkać prof. Beatę Sierocką, która razem ze swoim mężem – profesorem na Politechnice Wrocławskiej – założyła kierunek filozofia ze specjalnością komunikacja społeczna, w którym było sporo zajęć, które nazwałabym „prototechnologicznymi”, a zwłaszcza roczny wykład o podstawach sztucznej inteligencji. Ten wykład to była iluminacja. W liceum byłam olimpijką z filozofii, ale też z biologii – na tym wykładzie wreszcie pojawił się ktoś, kto powiedział „możecie myśleć bardzo abstrakcyjnie, na filozoficznym poziomie, a jednocześnie realizować bardzo praktyczny projekt”. Fascynacja powiła się w zasadzie sama. Sztuczna inteligencja to coś, co, z jednej strony, jest bardzo zanurzone w klasycznej metafizyce, a z drugiej strony – jest działaniem. Bardzo mi się spodobało, że można na przykład tworzyć boty pod test Turinga, co wymaga i pracy intelektu na najwyższych obrotach, i tego, żeby nauczyć się programowania.

Potem, już przekonana, że to jest to, co chcę robić, przyjechałam do Warszawy, gdzie dzięki szeregowi zbiegów okoliczności poznałam twórcę Wirtualnej Polski, Marka Borzystowskiego, który dziś jest dość znanym Aniołem Biznesu. On też był „zajarany” sztuczną inteligencją i zaczęliśmy rozmawiać o fundacji, w ramach której moglibyśmy przygotowywać boty do testu Turinga. Ostatecznie fundacja przeobraziła się w coś innego, ale jeśli chodzi o mnie – pasja została zaszczepiona.

Co to jest test Turinga?

Test Turinga to jeden z najważniejszych konceptów sztucznej inteligencji. Jeśli sztuczną inteligencję rozumieć jako symulowanie zachowań ludzkich, to test Turinga jest miarą, którą się to mierzy: na ile robot jest człowiekiem, na ile można przekonać człowieka, że to, z czym ma do czynienia, to też jest człowiek – podczas gdy jest to tylko i wyłącznie mechanizm. Alan Turing wymyślił to gdzieś w połowie XX wieku, a potem wielokrotnie wracano do tej koncepcji. Turing wymyślił ów test jako coś w rodzaju prowokacji. Powiedział, że jeśli po serii pięciu pytań i odpowiedzi coś przekona cię, że jest człowiekiem, to znaczy, że jest człowiekiem. Bardzo behawioralne podejście, które wielokrotnie kontestowano, ale które mimo wszystko utrzymało się przez tyle lat! Alan Turing był zresztą niesamowitą postacią, wymyślił też chociażby, że sztuczna inteligencja co do zasady nie ma płci…

Teraz chyba odchodzi się od tej zasady?

Rzeczywiście, dzisiaj zachodzi feminizacja sztucznej inteligencji. Widać to choćby po sexbotach, ale i właściwie wszędzie, gdzie w grę wchodzi komercyjne wykorzystanie botów czy usługi – jeśli to ma działać, to bot musi mieć płeć i najlepiej, żeby była to płeć żeńska. Dotyczy to także takich botów, jak np. ów słynny bot Microsoftu, które pozostawione do dyspozycji internautów uczą się zupełnie niestworzonych rzeczy. Jeśli sztuczna inteligencja ma być, jak chciał Turing, lustrem człowieczeństwa, to ostatnimi czasy się w tym lustrze przejrzeliśmy.

A czym zajęła się pani następnie?

W ramach programu Fulbrighta pojechałam do Stanów Zjednoczonych – do New School w Nowym Jorku – na studia socjologiczne z profilem medioznawczym. Podczas tych studiów pracowałam przez połowę czasu w Second Life – komputerowej grze wideo – przez dwa lata po osiem godzin dziennie. Była to część mojego projektu badawczego, ale i kluczowa, jak się później okazało, część mojego doktoratu. Tworzyłam tam boty, które zaczepiały graczy, a cały projekt dotyczył socjalizacji za pośrednictwem awatara, czyli na ile dzięki wirtualnej postaci można z sukcesem się socjalizować.

Socjalizacja w rozumieniu przygotowania do życia w społeczeństwie?

Tak, tylko że to jest zupełnie nowe społeczeństwo. To jest jakaś wersja świata, który znamy, ale wirtualna i w której wszystko jest powykręcane. Cały projekt dotyczył badania więzi i wspólnot, które wykształcały się w owym wirtualnym świecie, zastępując graczom rodzinę, procesy dojrzewania. Była to część rozbudowanego grantu prowadzonego przez profesor Eiko Ikegami, która dzisiaj jest dziekanem wydziału socjologii w New School. Od zawsze była zafascynowana Second Life’em, miała swojego awatara – motyla i wraz z mężem, który w grze był herosem-olbrzymem i nosił swojego motyla na ramieniu, spędzali sporo czasu w tym wirtualnym świecie, aż wreszcie postanowili swoje zainteresowania przekuć w projekt badawczy, który wyszedł bardzo ciekawie. Moim zadaniem było badać wspólnoty, które tworzyły się wewnątrz Second Life, ale także pisać i stawiać boty, których zadaniem było, po pierwsze, inicjować kontakty (socjalizacja), a po drugie, w miniskali iterować test Turinga. Praca przy tym grancie była dla mnie bardzo ważnym doświadczeniem, choć pod koniec już sama nie do końca wiedziałam, po której stronie bariery wirtualności jestem…

Jak pani widzi rozwój sztucznej inteligencji?

Już od tego pierwszego wykładu wiedziałam, że to jest temat dla mnie i będę się nim zajmować. Sztuczna inteligencja okazała się „moją” dziedziną filozofii – bo tak na to patrzę, jak na filozofię. Ale choć od początku miałam wokół siebie ludzi, którzy też byli zapaleni do tego tematu, znali się na tym obszarze i mnie wspierali, to dla większości była to egzotyka. W instytucie filozofii czułam, że robię coś ekstrawaganckiego, coś, co jest jak gdyby z boku i nie rozwiązuje realnych problemów. Jednak w międzyczasie stało się coś takiego, że dziedzina, którą się zajmuję, z marginesu stała się oczkiem w głowie całego świata. Wirtualizacja naszego życia i gospodarki idzie w parze z rozwojem sztucznej inteligencji i nie mogłaby się obyć bez wirtualnych agentów, którzy są w całości oparci na sztucznej inteligencji.

Jak się rozwija botyka dzisiaj?

Kiedy broniłam mój doktorat, boty, którymi się zajmowałam naukowo, miały słaby moment. W latach 2010-13 boty wydawały się trochę żenujące i czasami we wdrożonych już projektach wygadywały straszne głupoty, jak bot ZUS-u, który, zapytany „Gdzie są moje pieniądze?” smutno odpowiadał „Nie wiem”. Projekt symulowania inteligencji wydawał się gotowy do wyrzucenia na śmietnik. Wydawało mi się wtedy, że zrobiłam kosmiczny błąd, decydując się zajmować dziedziną bez przyszłości. Ale wtedy doszło do przyspieszonego rozwoju uczenia maszynowego i w naszym życiu pojawiło się mnóstwo rozwiązań opartych na agencie AI, takich jak Siri w telefonie czy Alexa – domowy robot społeczny skonstruowany przez Amazon. Bo to okazał się kluczową partią świata interakcji online, podstawowy interfejs kontaktu, który zwłaszcza dla młodszych generacji jest czymś, po co sięga się bez zastanowienia. Młody człowiek nie będzie wchodził na stronę danej firmy, logował się, płacił w mozolnej procedurze, tylko rzuci „Hej, Siri, chcę zapłacić za telefon w tym miesiącu”, a Siri odpowie mu na to „OK, płacę”. Dzisiaj jest to dla wszystkich oczywiste, ale jeszcze cztery lata temu nic tego nie zapowiadało. Wtedy czułam się jak trochę zwariowana pasjonatka, pewna, że mimo wszystko nie odpuszczę tematu, który jest dla mnie bardzo ważny. Na szczęście wystarczyło kilka lat, żeby okazało się, że zajmuję się najbardziej atrakcyjną dziedziną, o której wszyscy chcą wiedzieć coś więcej.

Dzisiaj kojarzona jest pani z występów w telewizji z robotami czy jako testerka inteligentnych ubrań, tzw. wearables.

Wearables są bardzo istotne! To są kolejni pośrednicy, harwestery danych – a my karmimy maszyny, które mają być inteligentne, właśnie takimi danymi. Dlatego im bardziej wrażliwe i kompleksowe dane zbiorą – na przykład o z grubsza rzecz biorąc aktywności umysłowej osoby, która je nosi – tym lepiej. Z punktu widzenia systemu, który ma się uczyć, ma cokolwiek rozumieć i być w jakikolwiek sposób sensowny, są to bardzo ważne dane. Wszystkie sensory IOT – internetu rzeczy (ang. internet of things) – podobnie jak sensory z technologii ubieralnych są szalenie istotne dla sztucznej inteligencji i uczenia maszynowego.

A czym dokładnie jest uczenie maszynowe?

To dziedzina, która ma nam pozwolić trenować maszyny, technologie – albo inaczej: sztuczne inteligencje – w wykonywaniu określonych zadań lepiej. Technologii uczenia maszynowego jest mnóstwo. Są takie, które są nadzorowane przez człowieka i polegają na prostym wkładzie opartym na typowych metodach statystycznych, takich jak regresja czy klastrowanie (czyli kategoryzacja problemów). Osoba, która się tym systemem zajmuje, wkłada mu określone porcje danych, ten system to jakoś przetwarza i działa według tego, co otrzymał. Ale są też technologie nienadzorowanego uczenia, kiedy sztuczną inteligencję konfrontujemy ze światem, w którego złożoności ona sama musi trochę nawigować. Ta dziedzina przyniosła ostatnio np. słynny projekt AlphaGo Zero.

Czyli?

AlphaGo Zero był to projekt stworzenia maszyny opartej na uczeniu przez wzmocnienie, która będzie grała w tradycyjną chińską grę go. Gra go to nie są szachy, jest to gra znacznie bardziej kompleksowa, wymaga rozmaitej wiedzy – w tym np. o psychologii przeciwnika – i wydawała się mało algorytmizowalna. W przeciwieństwie do szachów – nieprzyjazna dla komputera. Kiedy pierwszy program – AlphaGo – zbudowany przez firmę DeepMind – zaczął grać z legendarnym mistrzem Lee Sedolem, ten go po prostu wyśmiał. Trzy miesiące później przestał się śmiać – przez ten czas AlphaGo przegrał bardzo dużo meczy z bardzo dużą liczbą graczy, ucząc się bardzo dużo. Ostatecznie powalił Lee Sedola pięć do dwóch. A potem okazało się, że nie ma już z kim grać, bo wygrał ze wszystkimi mistrzami Europy, świata, wszechświata itd. Stwierdzono, że AlphaGo może już tylko grać sam ze sobą. I tak powołano do życia projekt AlphaGo Zero, który gra sam ze sobą miliony meczów go dziennie. AlphaGo Zero stwierdził, że ludzie do tej pory grali w go bardzo głupio i w ograniczony sposób, nie rozumiejąc zupełnie, jakie są horyzonty tej gry, np. jak można strategicznie ograć przeciwnika zupełnie inaczej, niż dotychczas to praktykowano. O tym mówi się często non-human game, nie-ludzka gra. Elementy tej nie-ludzkiej gry zastosował już w meczu z Lee Sedolem – zaskakując go na tyle, że mistrz przegrał. Już wtedy było widać, że program coś tu inaczej kombinuje. Na koniec powstała znakomita praca opisująca grę AlphaGo z AlphaGo Zero, w której tłumaczy się, że maszyna zaproponowała zupełnie iny paradygmat gry w go, pokazała, że zasady go mogą być radykalnie zredefiniowane i można grać zupełnie inaczej. To był wstrząs dla wszystkich, bo okazało się, że nienadzorowane uczenie maszynowe może przenieść człowieka daleko poza jego horyzonty poznawcze, a maszyna staje się nieoczekiwanym rozwinięciem i przedłużeniem ludzkich zdolności i wyobraźni. Ta raca odpaliła w 2017 roku. My wszyscy, którzy tkwimy w temacie sztucznej inteligencji, jesteśmy w AlphaGo Zero po prostu zakochani.

Jak będzie wyglądała przyszłość świata za, powiedzmy, dwadzieścia lat?

Nie wiem, czy dwadzieścia lat to horyzont jakiejś dużej zmiany. Oczywiście serwisowanie człowieka przez maszyny będzie postępowało, a wiele ludzkich aktywności będzie przejmowane przez maszyny, to dla mnie jest jasne. Natomiast zupełnie nie jest dla mnie jasne, jakie kompetencje po stronie człowieka będą potrzebne. Trudno mi uwierzyć, że na przestrzeni dziesięciu czy piętnastu lat zdezaktualizują się wszystkie zawody, jakie znamy. Pewnie będą się przeobrażać, będą potrzebne nowe umiejętności i współpraca z maszynami. Część pewnie zostanie tak, jak była. Algorytmizacja ma swoje granice, jest ściśle związana z neuronaukami. Najprościej mówiąc: jeśli czegoś nie będziemy wiedzieli o mózgu, to tego nie zrobimy w maszynie. I dlatego nie sądzę, by dwadzieścia lat to był horyzont jakiejś znaczącej zmiany. |

Dr Aleksandra Przegalińska-Skierkowska, filozofka, jest adiunktem w Katedrze Zarządzania Społeczeństwem Sieciowym na Akademii Leona Koźmińskiego w Warszawie oraz badaczką w Center for Collective Intelligence w bostońskim Massachusetts Institute of Technology.